Kenalan dengan ZAYA1-8B dari Zyphra. Model AI kecil dengan performa reasoning tinggi yang dilatih menggunakan hardware AMD.

Pernah nggak kamu membayangkan ada AI yang ukurannya kecil tapi bisa mengalahkan model yang jauh lebih besar? Nah, Zyphra baru saja mewujudkannya lewat ZAYA1-8B.

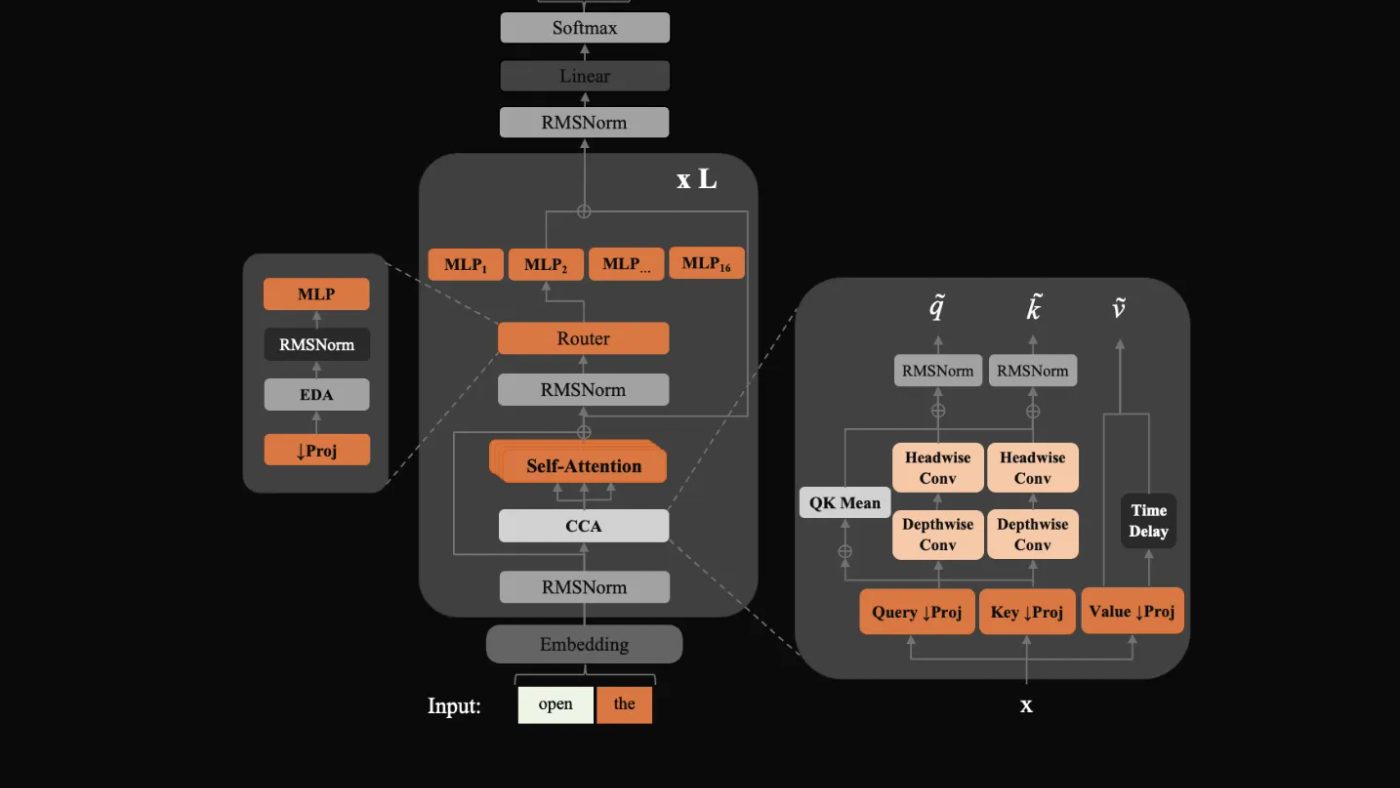

ZAYA1-8B adalah model bahasa berbasis Mixture of Experts (MoE). Meskipun total parameternya 8,4 miliar, yang benar-benar bekerja saat memproses data hanya 760 juta parameter aktif.

Artinya, model ini jauh lebih ringan dan cepat, tapi punya 'otak' yang sangat tajam, terutama untuk urusan matematika dan coding.

Yang menarik, ZAYA1-8B dilatih sepenuhnya menggunakan hardware AMD Instinct MI300. Ini membuktikan kalau ekosistem non-Nvidia juga bisa menghasilkan model kelas dunia.

Ada rahasia di balik kecerdasannya, yaitu arsitektur MoE++. Zyphra memperkenalkan Compressed Convolutional Attention (CCA) yang bisa mengompres memori KV-cache hingga 8 kali lipat.

Selain itu, mereka menggunakan router berbasis MLP dengan PID-controller agar pembagian tugas antar 'expert' di dalam model jadi lebih stabil dan efisien.

ZAYA1-8B juga dibekali metode baru bernama Markovian RSA untuk test-time compute. Sederhananya, model ini bisa 'berpikir' lebih lama dan mengoreksi jawabannya sendiri sebelum memberikan hasil akhir.

Hasilnya gila banget. Dalam beberapa benchmark matematika, ZAYA1-8B bahkan bisa mengungguli model besar seperti Claude 4.5 Sonnet dan mendekati performa DeepSeek-V3.2.

Kalau kamu bandingkan dengan model seukurannya, ZAYA1-8B menang telak di hampir semua kategori coding dan matematika dibandingkan Qwen atau Gemma.

Tapi perlu diingat, karena fokusnya adalah reasoning (penalaran), model yang jauh lebih besar mungkin masih lebih unggul dalam hal wawasan umum atau pengetahuan luas.

Kabar baiknya, model ini dirilis dengan lisensi Apache 2.0. Jadi, kamu bisa mencobanya secara gratis melalui Hugging Face atau Zyphra Cloud.

Kesimpulannya, ZAYA1-8B membuktikan bahwa efisiensi lebih penting daripada sekadar ukuran besar. Dengan optimasi yang tepat, model kecil pun bisa jadi juara.

Practical Takeaway: Jika kamu butuh AI untuk membantu coding atau hitungan rumit tapi punya keterbatasan hardware, cobalah model berbasis MoE seperti ZAYA1-8B karena lebih hemat memori namun tetap akurat.

AI Updates lagi bergerak cepat, jadi jangan cuma lihat headline.

MarkTechPost

Catatan redaksi

Kalau lo cuma ambil satu hal dari artikel ini

AI Updates update dari MarkTechPost.

Sumber asli

Artikel ini merupakan rewrite editorial dari laporan MarkTechPost.

Baca artikel asli di MarkTechPost→